L’Allen Institute for AI vient de lâcher un pavé dans la mare avec Olmo 3, une famille de modèles de langage entièrement ouverts qui compte bien rebattre les cartes face aux géants du secteur. Non seulement la nouvelle série se hisse au niveau des modèles commerciaux les plus performants, mais elle apporte surtout quelque chose que les « grands » n’osent plus offrir : une transparence totale, depuis les données d’entraînement jusqu’aux checkpoints intermédiaires. Ai2 détaille tout cela dans son annonce officielle, publiée sur son blog, où l’équipe explique la philosophie de ce nouveau modèle ouvert.

Ce lancement frappe d’abord par son degré d’ouverture. Les développeurs peuvent déjà télécharger les modèles et les données directement sur Hugging Face, où Ai2 a regroupé l’intégralité des ressources. Le rapport technique complet est lui aussi accessible, détaillant le pipeline de bout en bout, depuis Dolma 3 jusqu’aux scripts d’évaluation. Et pour tester le modèle immédiatement, il suffit d’ouvrir le Playground Olmo 3, ou de l’appeler via OpenRouter, où il est déjà disponible aux côtés des autres grands modèles du marché.

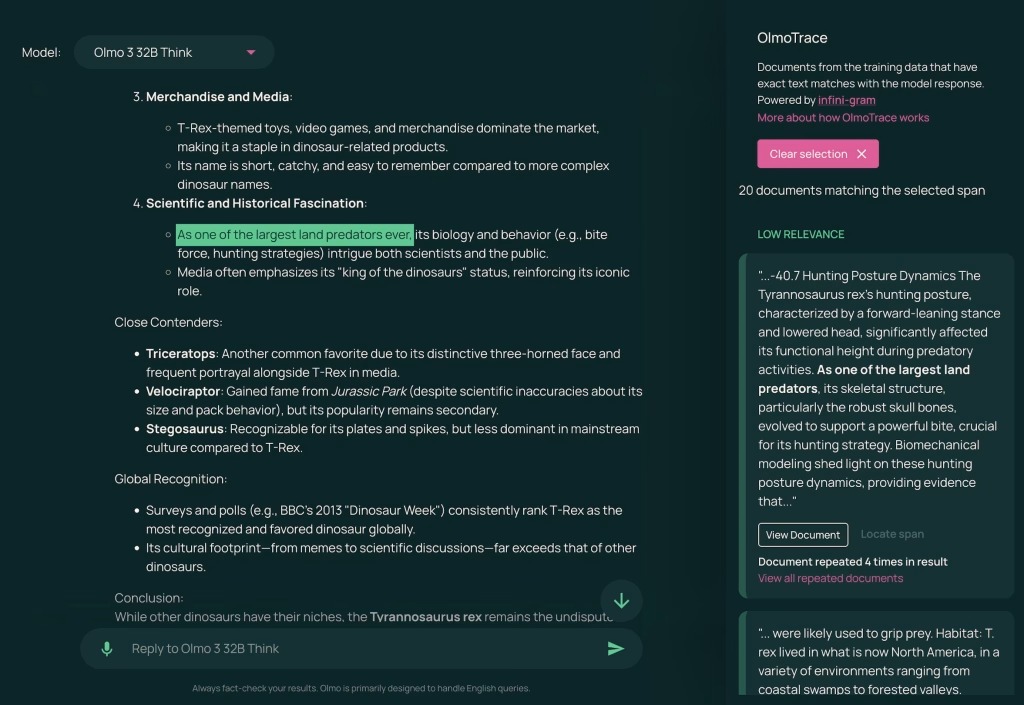

Cette transparence change tout : on peut suivre chaque transition du modèle, comprendre comment il raisonne, revoir les choix d’entraînement et même retracer les étapes intermédiaires grâce à OlmoTrace, l’un des outils que l’institut prévoit d’activer prochainement. C’est particulièrement spectaculaire avec Olmo 3-Think 32B, présenté comme le premier modèle de raisonnement entièrement ouvert à cette échelle, capable d’exposer une chaîne logique explicite. Une manière d’affirmer une approche scientifique face à la tendance actuelle aux “boîtes noires”, où les modèles les plus puissants ne dévoilent plus leur méthode ni leurs données.

Plus économe que Llama

Ai2 insiste également sur l’efficacité. Selon l’institut, Olmo 3-Base 7B aurait requis deux fois et demie moins de puissance GPU qu’un Llama 3.1 8B pour atteindre un niveau comparable. Même logique pour les modèles de raisonnement, entraînés sur six fois moins de tokens que leurs équivalents chinois comme Qwen 3-32B. Cette optimisation fait d’Olmo 3 l’un des projets les plus sobres du moment, tout en maintenant une qualité de réponse proche des meilleures alternatives open weight disponibles.

Cette sobriété est rendue possible par Dolma 3, un gigantesque corpus ouvert de près de six billions de tokens, couvrant le web, la littérature scientifique et le code. Ai2 publie tout : les sources, les règles, les filtres. Le dataset devient lui-même un outil de recherche, inspectable, vérifiable et réutilisable, sous licence Apache 2.0, sans la moindre restriction supplémentaire.

Olmo 3 est aussi taillé pour des cas d’usage concrets. Les modèles fonctionnent avec une fenêtre de contexte de 65 000 tokens, seize fois plus large qu’Olmo 2. Les variantes Base sont pensées pour le pré-entraînement continu ou le fine-tuning spécialisé. Les versions Think exposent les étapes du raisonnement. La version Instruct 7B, elle, optimise le dialogue, le suivi d’instructions et l’usage d’outils, ce qui en fait une alternative intéressante aux modèles propriétaires.

Ce lancement marque un tournant

Les modèles vraiment ouverts ne sont plus une option “en retard” par rapport aux modèles privés. Olmo 3 prouve qu’il est possible de combiner transparence totale, performance solide, reproductibilité et efficacité énergétique. Et surtout qu’on peut continuer à innover sans recourir à l’opacité ou à une puissance de calcul hors de portée. Avec Olmo 3, Ai2 s’affirme comme l’un des acteurs les plus sérieux du mouvement open source appliqué à l’intelligence artificielle.Même si (on le sait), tout cela va très, très vite….