Le framework de calcul distribué Ray, développé à l’origine par Anyscale et né dans les laboratoires de l’université de Berkeley, rejoint officiellement la PyTorch Foundation. Cette décision marque une étape importante dans la construction d’une pile d’infrastructure open source unifiée pour le calcul de l’intelligence artificielle.

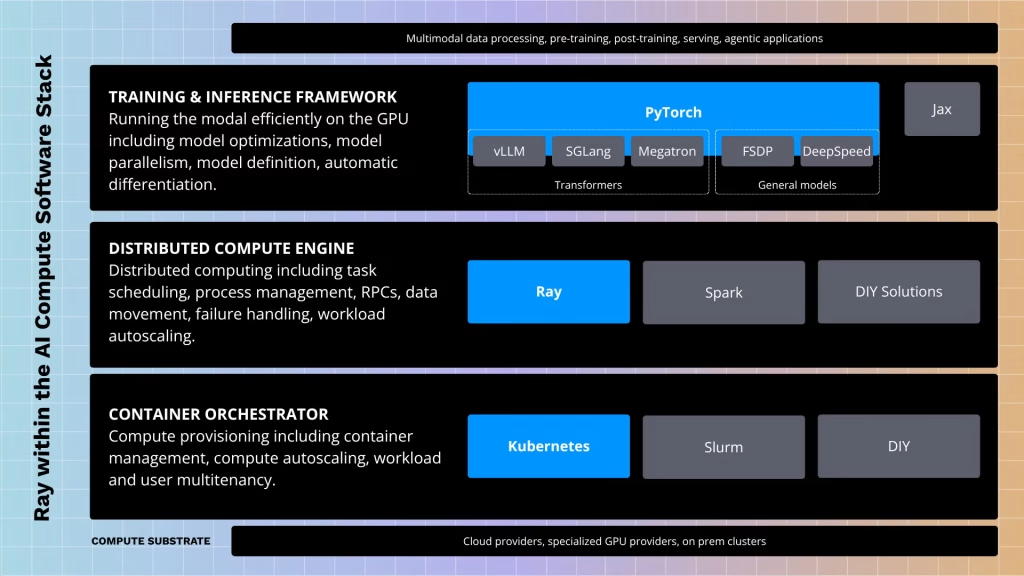

En intégrant Ray à la fondation, la communauté open source se dote désormais de trois briques complémentaires : PyTorch pour le développement de modèles, vLLM pour l’inférence, et Ray pour l’exécution distribuée. Ensemble, ces projets visent à simplifier l’architecture des systèmes IA, souvent fragmentée entre outils propriétaires et couches logicielles incompatibles.

Ray est devenu en quelques années une référence du calcul distribué, adopté par Uber, Netflix, ByteDance, Apple, JPMorgan ou encore BMW pour entraîner des modèles à grande échelle et exécuter des tâches de traitement massives. Son principal atout : permettre à une équipe de passer d’une exécution locale sur une seule machine à un déploiement sur des milliers de nœuds sans réécrire son code. Cette abstraction des contraintes d’infrastructure a fait de Ray une pièce maîtresse pour la montée en puissance de l’IA moderne, particulièrement dans les environnements multi-GPU.

« La Fondation PyTorch s’engage à favoriser un écosystème IA ouvert, interopérable et prêt pour la production », explique Matt White, directeur général de l’IA à la Linux Foundation. « En accueillant Ray aux côtés de vLLM et DeepSpeed, nous réunissons les composants essentiels pour construire les systèmes d’IA de nouvelle génération. »

Concrètement, Ray gère trois volets du calcul intensif : le traitement de données multimodales (texte, image, audio, vidéo), la pré-formation et l’optimisation post-entraînement sur des milliers de GPU, et l’inférence distribuée à grande échelle. Ces fonctions étaient jusqu’ici dispersées entre plusieurs outils, créant une dette technique considérable pour les entreprises tentant de passer de l’expérimentation à la production.

L’arrivée de Ray au sein de la fondation PyTorch renforce un mouvement de fond : celui d’une infrastructure IA réellement ouverte, capable de rivaliser avec les solutions propriétaires proposées par les grands fournisseurs de cloud. Ce socle unifié pourrait devenir un standard de fait pour le calcul distribué open source, de la formation à l’inférence.

La suite ? La communauté Ray se retrouvera dans quelques jours, début novembre, sous le soleil de San Francisco pour le Ray Summit 2025, où seront discutées les prochaines évolutions du framework et sa feuille de route au sein de la PyTorch Foundation.

Si vous le souhaitez, vous pouvez consulter le compte Github qui héberge le code source de Ray, publié sous licence Apache 2.0.